<勾配法(gradient method)>

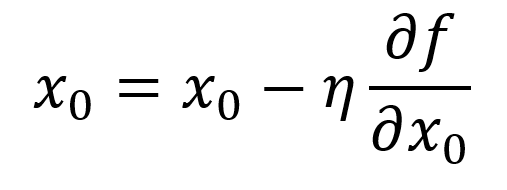

勾配法では,現在の場所から勾配方向に一定の距離だけ進みます。そして,移動した先でも同様に勾配を求め,また,その勾配方向へ進むというように,繰り返し勾配方向へ移動します。このように,勾配方向へ進むことを繰り返すことで,関数の値を徐々に減らすのが勾配法です。勾配法は機械学習の最適化問題でよく扱われる手法です。目的が最小値を探すことか,それとも最大値を探すことかによって呼び名が変わります。最小値を探す場合を勾配降下法,最大値を探す場合を勾配上昇法といいます。一般的に,ニューラルネットワーク(ディープラーニング)の分野では,勾配法は「勾配降下法」として登場することが多くあります。勾配法を数式で表すと以下のようになります。